Ivone, nostro lettore e ingegnere italiano che vive in Francia, ci ha inviato un nuovo articolo nel suo consueto stile da “ricercatore”: attento alle prove sul campo e poco incline agli entusiasmi facili. Proprietario di una Tesla che apprezza molto, ma senza “stravedere”, Ivone ha voluto sottoporre il Full Self-Driving supervisionato a un test del tutto originale e rigoroso che – a quanto ci risulta – nessuno aveva ancora fatto. Volentieri pubblichiamo il suo resoconto.

di Ivone Benfatto

Lo scorso dicembre, come molti altri proprietari Tesla, ho partecipato a una dimostrazione del Full Self-Driving (FSD) supervisionato come passeggero, esperienza che ho raccontato in un precedente articolo pubblicato su Vaielettrico. Dopo quella prova, però, mi sono chiesto se esistesse un modo più oggettivo e rigoroso per valutare il comportamento dell’FSD, andando oltre le centinaia di video disponibili online, spesso realizzati da appassionati molto entusiasti – i cosiddetti Tesla fanboy.

Non è una critica: anch’io sono rimasto impressionato dal comportamento dell’FSD, soprattutto nel traffico intenso. In molti frangenti la guida è paragonabile a quella di un ottimo tassista: fluida, prudente, prevedibile. Tuttavia, devo ammettere di partire con un certo pregiudizio, dovuto a un’esperienza personale poco soddisfacente con l’Autopilot base. Proprio per questo ho cercato un metodo di valutazione che prescindesse il più possibile dalle opinioni personali.

L’idea: sottoporre l’FSD all’esame per la patente B

Dopo la prima prova come passeggero, mi è venuta un’idea: perché non sottoporre il Full Self-Driving supervisionato allo stesso tipo di valutazione prevista per un candidato alla patente B?

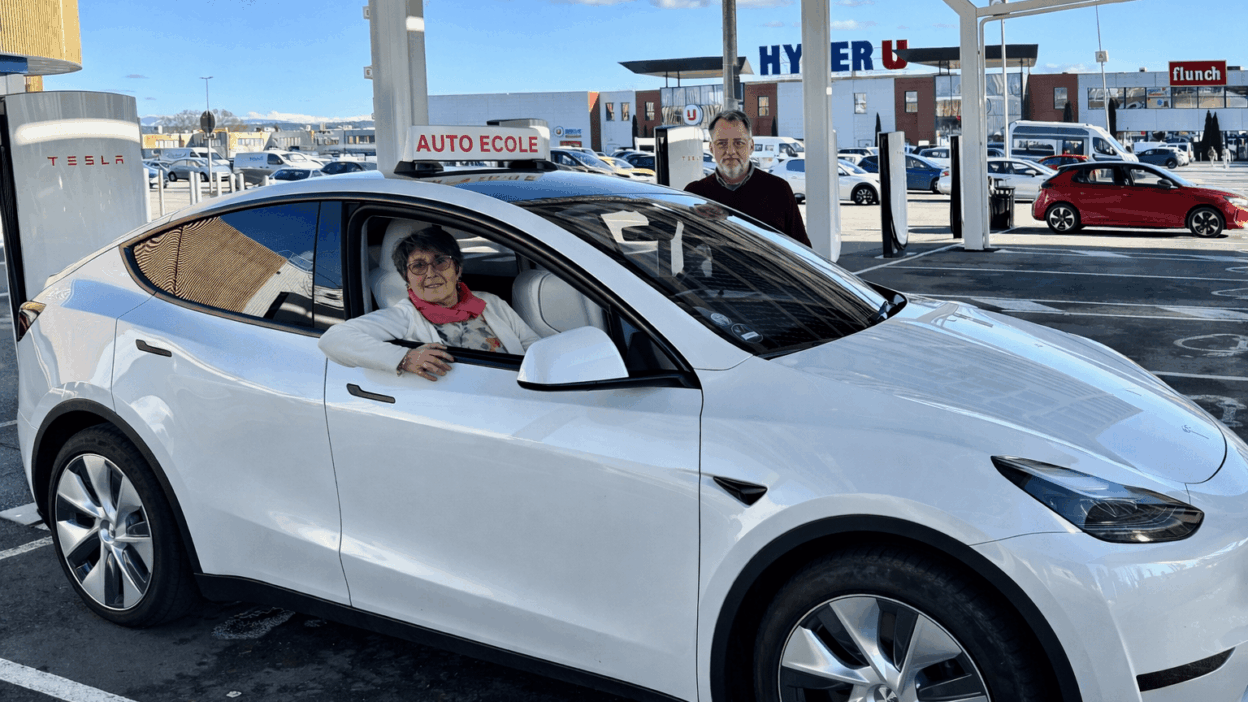

La coincidenza ha voluto che tra le mie conoscenze in Francia ci sia Michele, da poco in pensione, che per molti anni ha svolto il ruolo di esaminatrice per il rilascio della patente di guida. Le ho proposto di partecipare a una nuova dimostrazione del FSD come passeggera, osservando il comportamento dell’auto esattamente come se stesse valutando un candidato all’esame pratico.

Michele, una signora francese curiosa e brillante, amante dell’Italia e della cucina italiana (sta persino seguendo un corso di lingua italiana), ha accettato con entusiasmo. Ho quindi prenotato una nuova prova presso il centro Tesla di Marsiglia, svolta il 7 gennaio alle 16, in un orario di traffico piuttosto intenso.

Il verdetto dell’esaminatrice: guida eccellente, ma…

Al rientro dalla prova, Michele mi ha contattato con grande entusiasmo. Mi ha detto che il comportamento dell’auto ha superato di gran lunga le sue aspettative. Ha persino commentato che, se tutti i candidati che aveva esaminato negli anni avessero guidato in quel modo, il suo lavoro sarebbe stato molto più semplice.

Tuttavia – e qui arriva il colpo di scena – durante la prova si è verificato un errore considerato grave, di quelli che all’esame pratico comportano la bocciatura immediata.

Il conducente-supervisore Tesla era stato informato in anticipo della “particolarità” del test e si è mostrato molto curioso e collaborativo. Durante il percorso, Michelle non ha mai espresso giudizi né commenti. Solo alla fine, alla domanda: «Allora, com’è andata?», ha risposto senza esitazioni: «Purtroppo, bocciato».

Come funziona l’esame pratico di guida in Francia

Vale la pena spiegare brevemente i criteri dell’esame pratico per la patente B in Francia. La durata è di circa 40 minuti, simile a quella di una dimostrazione FSD. La valutazione si basa su una griglia composta da 31 criteri, e si articola in due livelli:

- Una valutazione a punti: per superare l’esame occorre ottenere almeno 20 punti su 31, relativi a stile di guida, uso corretto dei comandi, fluidità, rispetto delle regole, capacità di adattamento al traffico.

- Il rispetto delle regole eliminatorie: anche un solo errore grave comporta automaticamente la bocciatura, indipendentemente dal punteggio finale.

Tra gli errori che portano all’eliminazione rientrano, ad esempio: il mancato rispetto di uno stop o di un semaforo rosso, la mancata precedenza, la perdita di controllo del veicolo, un comportamento pericoloso per altri utenti della strada o l’intervento da parte dell’esaminatore su volante o pedali.

Sono invece tollerati errori minori, come lo spegnimento del motore in partenza, una marcia inserita non ottimale, una manovra leggermente imprecisa, un’indicazione di svolta leggermente tardiva o una certa esitazione, purché non generino pericolo.

In sostanza, l’esaminatore non cerca la perfezione, ma verifica che il candidato: abbia il controllo del mezzo, rispetti le regole fondamentali, anticipi i rischi, e guidi in modo autonomo e responsabile in condizioni di traffico reale.

Secondo Michele, l’FSD avrebbe superato senza difficoltà la soglia dei 20 punti nella valutazione generale. Un esempio? La gestione degli indicatori di direzione: li ha attivati correttamente e nel punto esatto previsto dal Codice della Strada, un aspetto sul quale molti candidati umani falliscono.

La bocciatura è arrivata esclusivamente per un errore eliminatorio.

L’errore fatale: una frenata ingiustificata

L’errore fatale: una frenata ingiustificata

Utilizzando Google Maps e Street View, ho ricostruito il punto esatto in cui si è verificato l’errore. Si tratta di un innesto su una superstrada senza pedaggio, dove è presente una corsia riservata agli autobus, regolata da un semaforo dedicato.

Il semaforo, contrassegnato dalla scritta “BUS”, era rosso. Questo segnale si applica esclusivamente agli autobus, non ai veicoli che percorrono la corsia ordinaria. L’FSD, però, con l’auto che viaggiava a circa 70 km/h, ha iniziato a rallentare per fermarsi.

Il conducente-supervisore Tesla ha riconosciuto l’errore ed è intervenuto sull’acceleratore, evitando l’arresto completo. L’auto ha poi proseguito correttamente, inserendo l’indicatore di direzione nel punto giusto.

Perché è un errore grave?

Qualcuno potrebbe obiettare: anche se l’auto si fosse fermata, chi segue dovrebbe rispettare la distanza di sicurezza. È vero, ma il Codice della strada francese prevede anche un obbligo di guida preventiva: il conducente non deve creare situazioni potenzialmente pericolose.

Una frenata o un rallentamento ingiustificato, soprattutto su una strada a scorrimento veloce, è considerato un errore grave perché aumenta il rischio di tamponamento, indipendentemente dalle responsabilità di chi segue.

Un problema che riguarda gli ADAS di molti costruttori

Colgo l’occasione per sottolineare che le frenate ingiustificate non sono un problema esclusivo delle auto elettriche o di Tesla. Riguardano i sistemi ADAS di ultima generazione, presenti anche su veicoli non elettrici.

In Francia, il tema è finito sotto l’attenzione delle autorità dopo un grave incidente in autostrada causato da una frenata automatica ingiustificata da parte di una Peugeot 208 (leggi). La conducente coinvolta ha lanciato un appello e raccolto segnalazioni riguardanti molti marchi automobilistici. Ne è scaturita un’inchiesta ufficiale, con un questionario dettagliato rivolto ai proprietari di auto immatricolate in Francia, invitati a segnalare la propria esperienza.

Il problema è complesso: da un lato esiste l’obbligo di mantenere la distanza di sicurezza, dall’altro sappiamo bene che nella realtà questa regola viene spesso ignorata, rendendo pericolose le frenate automatiche improvvise e non necessarie.

Soluzioni interessanti: le luci di posizione “blu o turchese” in Cina e di Mercedes

Soluzioni interessanti: le luci di posizione “blu o turchese” in Cina e di Mercedes

Ho trovato interessante una soluzione adottata in Cina: quando un’auto viaggia con sistemi di guida autonoma attivi (livello 4), si accendono luci di posizione blu o turchese, pensate per attirare l’attenzione di chi segue o si trova nelle immediate vicinanze.

Anche Mercedes, nei test di guida autonoma di livello 3 (attualmente sospesi), ha introdotto sui propri veicoli un indicatore di colore turchese (leggi).

In Francia esiste un concetto simile, chiamato “Guida accompagnata”, che consente ai futuri automobilisti di esercitarsi alla guida per più di un anno prima di sostenere l’esame, spesso utilizzando l’auto dei genitori. In questi casi, è obbligatorio esporre sul retro del veicolo un apposito disco con la scritta “CONDUITE ACCOMPAGNÉE”, per segnalare agli altri utenti della strada che al volante c’è un conducente in fase di apprendimento.

Un punto critico: la lettura della segnaletica stradale

Curiosamente, dopo aver avuto questa idea a dicembre, ho letto su un forum di proprietari Tesla un commento di un utente italiano esasperato dai ritardi normativi in Europa: «Perché non far fare al Full Self-Driving lo stesso esame che deve superare un essere umano?».

In fondo, è esattamente ciò che avevo chiesto a Michele di fare. Il risultato è chiaro: il test non è stato superato.

Il riconoscimento della segnaletica stradale resta una delle sfide più complesse per i sistemi di intelligenza artificiale. Pur avendo una base comune in Europa, la segnaletica presenta infatti numerose varianti nazionali che mettono in difficoltà i sistemi di guida assistita. Lo stesso vale per i semafori, che non si limitano ai classici segnali circolari: oltre a quelli con la scritta BUS, esistono semafori con simboli dedicati alle biciclette o con frecce direzionali.

Resta aperta la questione dell’origine del problema: si tratta di un limite del software di riconoscimento delle immagini oppure di una difficoltà legata alle telecamere, non solo nel caso di Tesla, ma per tutti i costruttori, che richiederebbe ottiche e sensori più adeguati?

Se la segnaletica dialogasse con l’auto…

Se la segnaletica dialogasse con l’auto…

Esiste però un approccio alternativo. Durante un viaggio in Cina lo scorso anno, ho potuto osservare come i sistemi di navigazione di bordo mostrino in tempo reale lo stato dei semafori e il conto alla rovescia fino al cambio di colore. L’informazione arriva direttamente dall’infrastruttura stradale, attraverso piattaforme di gestione del traffico, e viene poi trasmessa ai veicoli via rete mobile (4G/5G). Un metodo che elimina la necessità del riconoscimento visivo, ma che richiede sistemi di navigazione e infrastrutture tecnologiche più evoluti.

La strada verso la guida autonoma continua. E test come questo, forse, possono aiutare a capire dove siamo davvero arrivati.

- LEGGI anche “Tesla Full Self-Driving in Italia: la nostra prova su strada rivela come funziona davvero” e guarda il VIDEO

Come fa la guida autonoma a superare un incrocio dove per essere sicuro di passare senza auto in arrivo devi guardare uno specchio posto in alto all’altro lato dell’incrocio?

Non sono uno specialista di guida autonoma, quindi rispondo per ragionamento e buon senso tecnico.

In un incrocio dove, per impegnarti in sicurezza, devi guardare uno specchio convesso posto dall’altra parte, “leggere” lo scenario non è banale neppure per un umano: lo specchio è curvo, introduce un effetto grandangolare che riduce i dettagli e soprattutto altera la percezione di distanza e velocità. A volte anch’io faccio fatica a stimare quanto sia lontana un’auto che arriva e a che velocità stia procedendo. E poi ci sono condizioni peggiorative: al mattino, con nebbia, brina o sporco, lo specchio può diventare poco affidabile.

Per un sistema di guida automatizzata, basarsi solo sull’interpretazione dell’immagine nello specchio tramite telecamere è possibile in teoria, ma è complesso: serve riconoscere lo specchio, “capire” che sta mostrando una scena riflessa, compensare la distorsione e ricostruire traiettorie e tempi di arrivo con sufficiente accuratezza.

La soluzione più robusta, secondo me, è che l’auto disponga di sensori capaci di rilevare direttamente il traffico trasversale all’anteriore, un po’ come fanno già molti veicoli moderni con l’allerta traffico trasversale (solo che spesso è pensata per il posteriore in manovra). Qui non entro nella disputa “bastano le telecamere o servono anche radar/ultrasuoni”: dico solo che, per questi casi limite, avere ridondanza sensoriale (telecare e/o altri sensori) potrebbe essere necessario.

Per esperienza: durante un test come passeggero del Tesla FSD che ho fatto lo scorso dicembre (e di cui ho scritto), mi è capitato un incrocio con visibilità trasversale ridotta. Ho notato che l’auto avanzava molto lentamente, finché non otteneva abbastanza informazioni per decidere. A un certo punto ha iniziato ad accelerare con una certa decisione prima che il conducente, e io seduto davanti, potessimo vedere chiaramente se ci fossero automobili in arrivo. È possibile che abbia sfruttato le immagini delle telecamere posizionate sui parafanghi anteriori, che sono circa 1–1,5 metri più avanti rispetto agli occhi del conducente e quindi possono “sbirciare” prima oltre l’ostacolo.

Infine c’è un punto regolatorio importante: quando si parla di guida autonoma livello 3 o superiore, cioè senza supervisione costante del conducente, l’abilitazione avverrà su strade/aree ben definite. Non escludo che incroci con visibilità così scarsa da richiedere lo specchio possano essere, almeno nei primi anni, esclusi dalle tratte autorizzate per L3 o superiore.

Ringrazio Ivonne per questa utilissima prova.

Personalmente sono certo che i tecnici di Tesla avranno fatto tesoro di questa “segnalazione” e che il software di guida SFD verrà aggiornato entro pochissimi giorni.

Affidarsi al sistema di guida autonoma di Tesla fa si che una volta individuato l’ errore è possibile impedire che possa ricapitare

idea del test e racconto divertenti, grazie Ivone 🙂

sto pensando se le conclusioni non siano da leggere all’incontrario:

..cioè se io percorressi in velocità per la prima volta quella strada forse avrei esitato per la necessità di interpretare la segnaletica.. da un parte la preoccupazione di essere tamponati se mi fermo con un semaforo “rosso” non era per me, e dall’altra la paura di prendere una multa con foto automatizzata se basandomi sulla visuale libera avessi passato un rosso che invece era effettimente anche per me

– anche nei percorsi abituali che invece conosco, mi vengono in mente un paio di situazioni stradali strambe che anche conoscendole in anticipo, mi creano esitazione e alla fine si deve passare a vista, non a codice

visto che il software dell’auto è già mediamente “istruito meglio” di molti umani, e più veloce a vedere e ragionare; se pure lui, al pari di me guidatore di lunga data, fallisce, potrebbe essere un test per riconoscere non un bug del software (possibilità comunque sempre da verificare per prima), ma un bug del Comune che ha realizzato quella viabilità, cartellonistoica, semaforica

cioè la guida autonona potrebbe diventare un test non più soggettivo per segnalare al Comune i punti stradali “ambigui/pericolosi” da modificare?

Sono perfettamente d’accordo con te, pensa che nei paesi arabi anziché BUS c’è scritto حافلة, forse era preferibile utilizzare una segnaletica dedicata come per i tram.

Ivone, cambi i copricerchi sil vous plait. Inguardabili.

Ecco, quindi l’unico appunto fatto alla guida autonoma di Tesla – ben spiegato dall’ottimo Guido – non ha niente a che fare con la mancanza di LiDAR, che ancora adesso in molti (Waymo per prima, ovviamente) continuano a tirare fuori. Ormai dimostrabilmente “a sproposito”, aggiungerei.

mi dispiace ValerioZ ma dissento profondamente; la prova di Ivone dimostra che le vetture “guidano molto bene” ma possono commettere errori come un qualsiasi essere umano, dovute ad errori di interpretazione della situazione, a maggior ragione quando la loro “percezione del mondo” può essere limitata dai set dati disponibili in base ai sensori di cui son dotate.

Io non affiderò mai la mia vita (e dei passeggeri.. e degli altri attorno a me) ad un sistema di guida che “percepisce l’ambiente e le sue problematiche” meno di me, caso mai potrei farlo con tanta circospezione ed attenzione ad uno che “ha più strumenti di me” (come radar & lidar e dati forniti da sistemi su strada) che possono reagire quantomeno in tempi molto migliori e soprattutto perché vedono cose che io non posso (nella nebbia, pioggia fortissima etc).

Con la guida a volte spericolata di certi soggetti (che si insinuano senza neppure la freccia ) davanti al muso in sorpassi spericolati, senza distanza di sicurezza, ondeggiando oltre le strisce delle carreggiate etc si rischia di veder innescare comportamenti anomali anche dal più sofisticato sistema automatico.

Il giorno che magari le autostrade saranno aperte a solo vetture con FSD e simili, guidando tutte in modo uniforme e “a norma di CdS”, velocità e distanze comprese, magari mi affiderò con più tranquillità… ma fino ad allora sulle mie auto – e la mia BEV – guido io, e tengo a bada gli ADAS !

Continui, come molti, a fare gli stessi errori di ragionamento che anni fa potevano starci, ma adesso dimostrabilmente no.

Guidare non è complicato per una questione sensoriale, ma di comprensione dell’ambiente e della situazione. Comprensione che migliora con l’aumento di dati a disposizione (= esperienza, per farla semplice), non aggiungendo altri sensori.

L’unico problema sollevato nel test è appunto una questione di esperienza (certe specificità del codice della strada francese non sono ancora nel data set di quella versione di FSD), è LiDAR o radar non avrebbero aggiunto niente di utile: anzi, valutare anche i loro dati, avrebbe tolto capacità computazionale (= capacità di ragionamento, grossomodo) al resto.

Guarda che a certi livelli non c’è già più discussione a riguardo, infatti anche altre case impegnate nel settore stanno abbandonando i LiDARs. Continuano a crederici e spingerci solo quelli che ci hanno investito (per ovvi motivi), o quelli che non sono del settore (per altrettanto ovvi motivi), o in semplice malafede (idem).

SE io commetto un errore, e magari mi va bene, Imparo .. ne tengo conto per le volte successive.

SE lo commette un FSD , se va comunque bene, resta tutto uguale finché non verrà riprogrammato correggendo l’errore.

Attualmente i software con A.I. NON stanno affatto dimostrando assenza di errori, anzi !

A me son già capitate situazioni rischiose per frenate automatiche (magari giuste nell’interpretazione) ma da allora mi tengo a gran distanza dalle auto più recenti alle velocità più alte perché non so mai se qualcosa le indurrà a frenare di colpo.

Chi se la sente, è liberissimo di rischiare su auto a guida autonoma.

In bocca al … FSD

Molto interessante! Anche io ho fatto la prova con FSD ed ho avuto un’esperienza simile: guida fluida e perfetta, tranne un solo impasse, per una strada dove la viabilità era cambiata da pochi giorni e l’auto ha esitato. La soluzione di indicatori colorati per segnalare la guida autonoma mi pare geniale! Poi per il resto basterebbe rispettare sempre le distanze di sicurezza ed il risultato finale sarebbe un crollo del numero di incidenti, feriti, decessi.

A discapito di Tesla: è una versione dimostrativa per l’Europa che NON ha recepito completamente il codice stradale in vigore in ogni stato europeo.

Quel segnale specifico, ad esempio, non esiste in Italia (tantomeno in USA) ma in Francia sì, quindi la macchina lo ha interpretato genericamente come semaforo rosso non riconoscendolo.

-Quel segnale specifico, ad esempio, non esiste in Italia (tantomeno in USA) ma in Francia sì-

Perchè come si dice fra appassionati di auto: “The french copy no one and no one copies the french”.

Caro Alessandro,

il suo commento mi ha fatto venire in mente un aneddoto divertente: la Francia ha adottato le direttive UE sulle targhe automobilistiche piuttosto tardi, intorno al 2009, parecchi anni dopo l’Italia. E quando lo fece scelse la stessa sintassi adottata da molto tempo in Italia: due lettere – tre cifre – due lettere, con le due strisce blu ai lati.

Un conoscente francese, dopo un viaggio in Italia, mi disse serissimo: “Sono stato in Italia e ho visto che avete copiato il nostro modello di targhe!”

Ritratto perfetto dei francesi, in sole 5 righe: chapeau

Ci crederebbe se io le dicessi che a Ventimiglia, nei primissimi anni 2000, ho sentito dei francesi argomentare con estrema convinzione sul fatto che gli Euro francesi valessero qualcosina di più di quelli italiani?

Caro Guido,

infatti nell’articolo ho scritto: “Il riconoscimento della segnaletica stradale resta una delle sfide più complesse per i sistemi di intelligenza artificiale. Pur avendo una base comune in Europa, la segnaletica presenta infatti numerose varianti nazionali che mettono in difficoltà i sistemi di guida assistita.”

Ma, mi sono anche posto la domanda:

“Si tratta di un limite del software di riconoscimento delle immagini oppure di una difficoltà legata alle telecamere, non solo nel caso di Tesla, ma per tutti i costruttori, che richiederebbe ottiche e sensori più adeguati?”

Presumo, ma ammetto che non sono esperto in materia, che non sia facile riconoscere scritte e simboli molto luminosi e di dimensioni relativamente piccole.

Quando arriverà la versione omologata cercherò di organizzare una nuova prova.

Sarà mica che per sbaglio l’amica dell’ottimo Ivone in realtà si chiama Michelle, con due L? 😉

No

Confermo che non è un errore di stampa.

Come in Italia, esiste Ivone per gli uomini, in Francia esiste Michele per le donne.