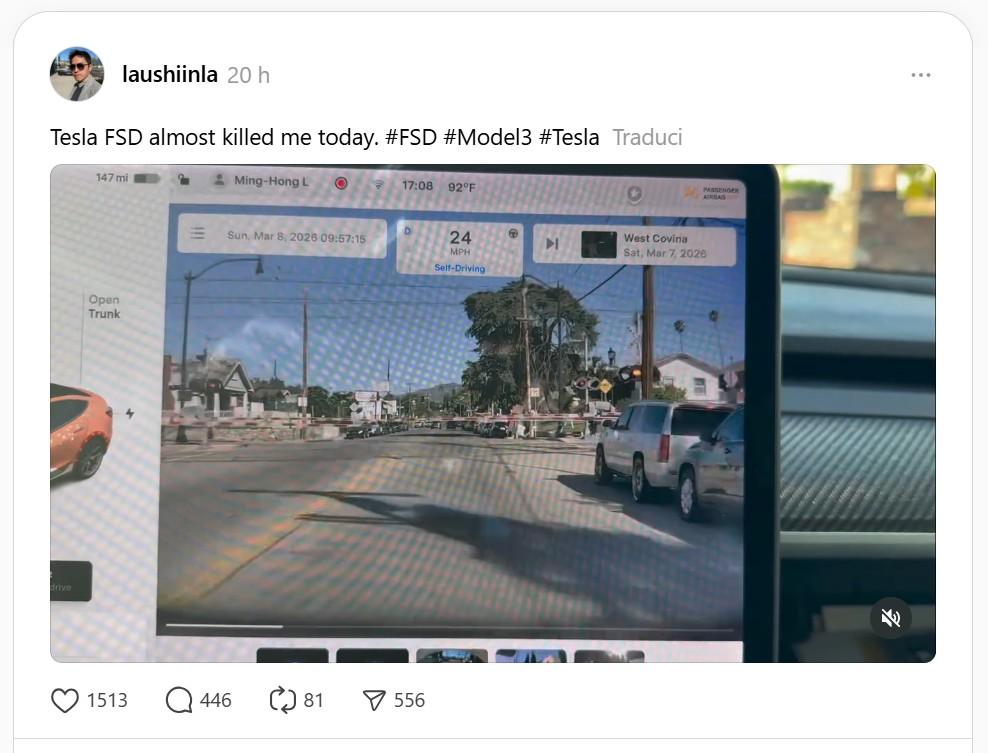

Un video diventato virale nelle ultime ore mostra una Tesla che, con il sistema FSD (Full Self-Driving) attivo, attraversa senza rallentare le barriere abbassate di un passaggio a livello ferroviario. L’episodio, ripreso dalla dashcam di una Model 3 negli Stati Uniti, è stato postato sui social domenica dal proprietario che l’ha titolato «Tesla FSD mi ha quasi ucciso oggi». Arriva proprio nel giorno in cui Tesla deve consegnare alle autorità americane dati chiave sulle infrazioni registrate dal suo software di guida automatizzata.

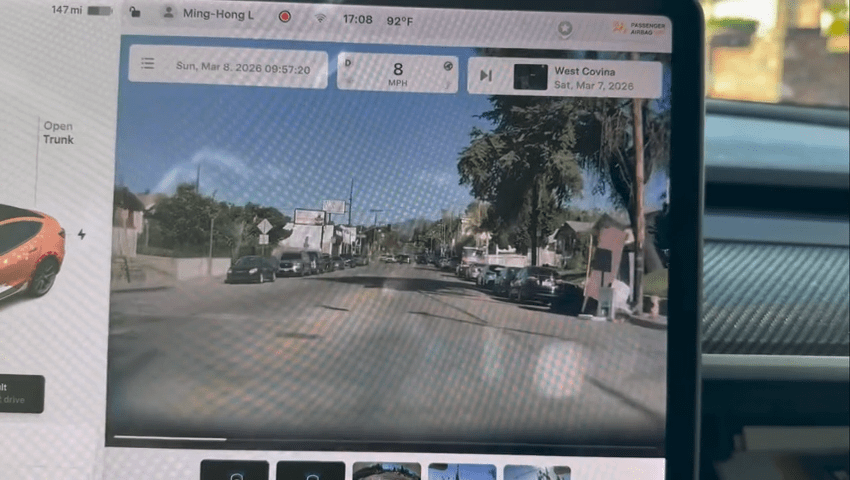

Il filmato mostra la vettura procedere a circa 23 mph (circa 37 km/h) mentre si avvicina a un passaggio a livello nell’area di West Covina, in California. Le sbarre sono già abbassate quando l’auto continua la marcia e le colpisce senza che il sistema intervenga per fermarsi. Solo all’ultimo momento il conducente tenta di frenare.

Il filmato che riapre il caso sicurezza

Secondo quanto riportato dal sito Electrek, la scena è stata registrata l’8 marzo dalla dashcam dell’auto. Il sistema di assistenza alla guida non avrebbe riconosciuto le barriere ferroviarie, che si trovavano all’altezza delle telecamere anteriori della vettura.

Il proprietario ha commentato il video scrivendo sui social: «la Tesla con FSD mi ha quasi ucciso oggi». Il post ha rapidamente accumulato migliaia di visualizzazioni e commenti.

Molti utenti hanno ricordato che la funzione Full Self-Driving non rende l’auto autonoma: si tratta di un sistema di livello 2, che richiede la supervisione costante del conducente. Tuttavia, l’episodio alimenta le critiche su una denominazione commerciale che può indurre a sopravvalutare le reali capacità del sistema.

Tesla Full Self-Driving in Italia: la nostra prova su strada rivela come funziona davvero

I passaggi a livello, punto debole della guida autonoma

Il problema dei passaggi a livello non è nuovo. Negli ultimi anni diversi conducenti hanno segnalato episodi in cui la guida assistita di Tesla avrebbe avuto difficoltà a riconoscere la presenza di binari, segnali luminosi o barriere. Secondo un’indagine citata dai media americani, sui social sono emerse oltre quaranta segnalazioni di malfunzionamenti in prossimità dei passaggi ferroviari, alcune corredate da video. In almeno un caso documentato, una Tesla è stata colpita da un treno dopo essere finita sui binari mentre il sistema di guida assistita era attivo.

Situazioni di questo tipo sono particolarmente critiche perché un passaggio a livello rappresenta un ambiente altamente standardizzato: segnali luminosi, barriere fisiche e segnaletica orizzontale dovrebbero essere facilmente identificabili da sensori e algoritmi.

L’indagine federale su milioni di Tesla

Il tempismo del video è significativo. Proprio il 9 marzo è scaduto il termine entro cui Tesla deve consegnare alla National Highway Traffic Safety Administration (NHTSA) una grande quantità di dati legati alle infrazioni stradali registrate con il sistema FSD.

L’indagine dell’agenzia americana riguarda circa 2,88 milioni di veicoli equipaggiati con il software e prende in esame decine di episodi, tra cui attraversamenti con semaforo rosso, ingresso in corsie opposte e incidenti con feriti.

Tesla aveva già ottenuto due proroghe per consegnare i dati richiesti. L’azienda ha spiegato che oltre 8.000 segnalazioni devono essere analizzate manualmente prima di poter essere inviate all’autorità federale.

Guida autonomia o assistita? L’equivoco può costar caro

Il caso riporta al centro una questione che accompagna da anni lo sviluppo della guida automatizzata: il divario tra assistenza alla guida avanzata e vera autonomia.

Il sistema di Tesla, pur chiamandosi “Full Self-Driving”, è tecnicamente classificato come ADAS di livello 2, cioè un sistema che può controllare sterzo, accelerazione e frenata ma richiede l’attenzione continua del conducente.

- LEGGI anche: Tesla FSD “sotto esame”: promosso alla guida, ma bocciato per la patente e guarda il VIDEO

Premesso che Waymo è una guida omologata senza conducente, anche se poi in realtà si sa che alle spalle c’è sempre un centro di controllo con del personale, mentre l’FSD di Tesla di Full ha invece molto marketing e meno sostanza.

Detto questo muovere un’ auto nel traffico in un contesto urbano è tutt’altro che facile perché l’interazione è massima e se risulta impegnativo per un umano figuriamoci per dei sensori.

L’IA potrà dare una mano ma i fattori che influenzano una guida sono talmente tanti che è difficile campionarli tutti ed avere per ognuno la risposta corretta e risolutiva.

Usare l’FSD di Tesla è come fare scuola guida, devi sempre tenere d’occhio chi sta guidando ed intervenire invece il messaggio di Tesla ti dice altro, ne fa nulla per garantire che chi è alla guida sia vigile. Altre vetture bloccano in automatico la guida autonoma avvisando per tempo il conducente Tesla continua imperterrita e il risultato è che la gente si schianta. Non puoi pensare che un sistema simile su alcune vetture considerate più datate non possa essere aggiornato o bloccato se diventa pericoloso.

Ma perchè dovete scrivere con supponenza di cose che evidentemente non avete provato o non conoscete?

Un guazzabuglio di cose vecchie o vecchissime, sentito dire, o da frasi o spezzoni video presi qui e la fuori contesto…

Stanco di vedere video di cosa fa o non fa il FSD. Quando sara’ omologato Lev3 o, finalmente, Lev4 chiamate. Personalmente, ad ogni proposta di nuovi video di Tesla su YouTube sengnalo come non interessa.

Ma perchè la gente si meraviglia di questi episodi? Il FSD di Tesla è semplicemente una guida assistita di livello 2. Tesla ha però sbagliato a chiamarlo FSD, non avrebbe mai dovuto usare questo termine: “chi è causa del suo mal, pianga se stesso”

Ovviamente Electrek dimentica di far notare che si tratta di una versione vecchia, sull’hardware più vecchio supportato.

Mah eh, ci volevano i LIDAR, come Waymo.

Anzi, no, guardate che combina Waymo:

https://x.com/DigitalDaisyX/status/2031697864582144325

Sì, sarebbe bello se la tua auto diventasse il tuo “treno o taxi personale”: “Buongiorno, mi porti al lavoro, per favore. Grazie”

Ma così non è, i sistemi di guida assistita riescono ad alleviare la fatica di quell’ora abbondante di strada per andare al lavoro e questo mi basta. Se ci si affida totalmente al mezzo meccanico o cibernetico, si fa una scelta e ci si prende la responsabilità di questa scelta.

Ne manca ancora per arrivare a un sistema affidabile…

se avessero lasciato i lidar assieme alle telecamere avrebbe frenato ma per musck è più importante dimostrare l’impossibile che dare sicurezza… un laser non sarà mai inferiore ad una vista 3d…

Negli Stati Uniti, la FSD di Tesla rimane supervised (Level 2) e richiede supervisione costante del conducente. Non è ancora autorizzata unsupervised (Level 4 o superiore) per uso personale o su strade pubbliche generali.

Questo significa che chi è alla guida di un’auto con FSD è responsabile del controllo del veicolo. Tesla sta completando i test e correggendo i problemi per arrivare a una guida completamente sicura non supervisionata dall’uomo appena tutti i test e le correzioni dei problemi saranno completati

Il prossimo step…

https://youtu.be/QK9kUbLUhWc?si=9_AIGXeciKfhRmwI

Magari! Una Tesla non è mica la Bluesmobile! E chi la guida non è in missione per conto di Dio! 🙂

Concordo al 150%

Questi sono pericolosi, dovrebbero toglierli la patente, oggi le sbarre e domani investono un pedone e scaricano la colpa sulla macchina…