Autopilot Tesla, sono 11 gli incidenti al centro di una nuova inchiesta delle autorità federali americane. I crash tutti avvenuti contro mezzi di soccorso.

Autopilot Tesla, tutti i crash contro mezzi di soccorso

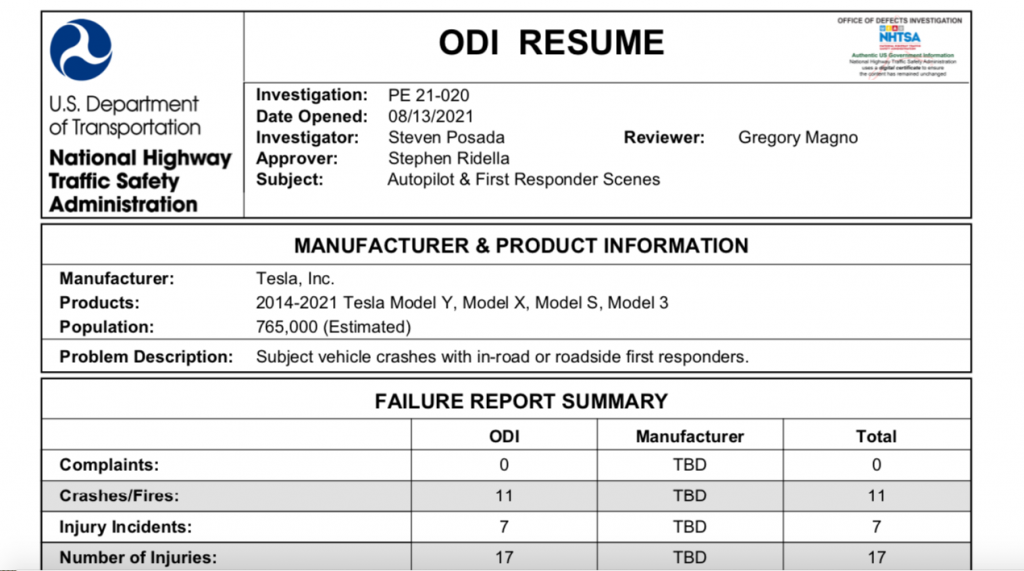

Il nuovo fascicolo è stato aperto dalla National Highway Traffic Safety Administration (NHTSA), l’ente che vigila sulla sicurezza stradale. E la particolarità sta appunto nel fatto che in tutti e 11 i casi esaminati le Tesla in questione hanno investito veicoli di emergenza e di primo soccorso. In tutto con un morto e 17 feriti. In L’indagine riguarda tutti e quattro i veicoli della gamma Tesla: Model S, Model X, Model 3, Model Y, con incidenti avvenuti un po’ in tutti gli Stati Uniti. E sempre con il pilota automatico (l’Autopilot appunto) inserito. Si tratta di un sistema di assistenza alla guida di Livello 2 articolato in diverse funzioni. Le più utilizzate sono comunque due:

- l’Autosteer, che consente al veicolo di sterzare automaticamente all’interno delle corsie in autostrada

- il Traffic-Aware Cruise Control, che regola la velocità in base al traffico.

C’è qualcosa che “confonde” il pilota automatico?

Nell’annunciare l’indagine, la NHTSA precisa di voler valutare “le tecnologie e i metodi utilizzati per monitorare, assistere e rafforzare l’impegno del conducente“. Tutto questo “con l’attività di guida dinamica durante il funzionamento del pilota automatico“. Ma la particolarità degli incidenti sta appunto nel fatto che le auto in questi 11 casi sono andati a sbattere contro mezzi di soccorso. Come mai? C’è qualacosa che “imbroglia” l’Autopilot? “La maggior parte degli incidenti si è verificata dopo il tramonto“, spiega ancora l’NHTSA. Aggiungendo che le scene dei crash presentavano dispositivi come le luci d’emergenza del veicolo di primo intervento, frecce illuminate e coni stradali. Degli 11 incidenti, quattro sono avvenuti nel 2021: l’ultimo a San Diego, in California, il 10 luglio. Un anno fa, invece, uno dei botti più discussi avvenne in Nord Carolina, con un’auto della Polizia ferma a bordo strada investita da una Tesla Model S. Il conducente spiegò di non essersi accorto del pericolo: guardava un film con l’Autopilot inserito.

Si potrebbe banalizzare dicendo che la colpa è della mancanza di un lidar ma non è così. La tecnologia adottata da Tesla è davvero la più evoluta oggi possibile, solo che va ancora perfezionata: non a caso Tesla si sta dotando di supercomputer più veloci capaci di analizzare petabyte di video in modo da perfezionare l’individuazione dei trigger che determinano le correzioni che l’auto deve applicare.

I concorrenti non sono messi meglio. Il 12 agosto, ad esempio, è morto un noto imprenditore 31enne con una Nio ES8 con NOP attivo (il NOP è l’equivalente dell’autopilot di Tesla).

Il problema “legale” della Tesla (e dei concorrenti) è che non applica sufficienti controlli per verificare che il pilota dell’auto sia effettivamente concentrato e pronto a riprendere i comandi. Di fatto è una tecnologia “Level 2” che viene percepita (e fatta percepire?) come una Level 3 o Level 4, a partire già dal nome. La tecnologia la si può già usare, con qualche piccolo accorgimento, in modalità totalmente autonoma, a proprio rischio e pericolo: un rischio sul quale NHTSA vorrà indagare.

Enzo sul discorso Lidar potremmo scrivere dei libri ma, di fatto, e’ una tecnologia basata su una perfetta mappatura della strada e dell’ambiente circostante, impossibile coprire una nazione o, peggio, un continente intero. E’ dimostrato, tra l’altro, che appena le condizioni sono divere da quelle mappate il sistema entra in crisi. L’approccio di Tesla e’ molto piu’ ambizioso e “pretende” di essere in grado di affrontare qualsiasi strada utilizzando un’AI opportunamente addestrata. Dubito che riusciranno ad arrivare ad un livello 4 o superiore a brevissimo, ma se dovessero riuscirci non ci sara’ confronto con i sistemi Lidar (e nemmeno di costo).

Sul discorso “controlli”, a partire dall’ultimo aggiornamento la camera interna controllera’ che il guidatore mantenga l’attezione sulla strada (e non solo le mani sul volante, cosa che abbiamo visto aggirabile dai piu’ imbecilli), altrimenti richiede di riprendere il contriollo e se non lo fai accosta, mette le 4 frecce e si ferma. Vediamo cosa si inventeranno stavolta per ovviare, ma non si puo’ dire che non ci siano tentativi per frenare gli stupidi.

Sul tipo di controllo della NHTSA non entro in merito perche’ se ne fanno tantissimi (ed anche doverosi). Potrebbe anche essere che l’AP avesse qualche problema nel rilevare i mezzi di soccorso con i lampeggianti attivi in particolari condizioni (a me mai capitato, ma non faccio statistica, giustamente), pero’ c’e’ anche da rilevare che su diversi degli 11 casi in esame ci sono parecchie ombre. In ogni caso io sono il secondo (da usufruitore non solo dell’AP ma anche dell’FSD) interessato a che le indagini facciano luce su quanto successo (il primo e’ Tesla).

Certe persone dovrebbero guidare la Duna a gas invece si comprano la Tesla, non sono capaci di usarla , si schiantano e poi ( spesso per motivi assicurativi ) danno la colpa all’auto e al suo Autopilot. E dietro c’è subito chi cavalca l’onda dello scoop …( fasullo ovviamente).

Carlo, non è uno scoop e non è fasullo: è un comunicato ufficiale dell’ente americano che vigila sulla sicurezza stradale. Indagini del genere, in passato, sono finite nel nulla e noi ne abbiamo dato notizia, così come seguiremo l’evolversi di questa indagine.

Nel 2017 ci sono state 54 milioni di persone ferite in incidenti stradali con 1,2 milioni di morti. Quando ci sarà un’inchiesta sulle auto a guida umana?

Che discorso è? Le inchieste si fanno sui guidatori che appunto guidano! . In questo caso si indaga sul guidatore che si faceva i cavoli suoi e sull’autopilot x vedere se qualcosa non funziona a dovere

quindi, per colpa di alcuni criminali e idioti, diamo la colpa all’autopilot? Mah..

Sono perfettamente d’accordo con te Sandro . L’Autopilot di Tesla è estremamente sicuro ed efficace. Ed infatti, ad oggi, nessuno è riuscito a dimostrare il contrario ,nonostante le varie inchieste e denuncie .

E a che serve il pilota automatico se devo controllarlo ? Almeno quello degli aerei funziona, a parte gli scherzi io difficilmente mi fiderei anche perché normalmente riesci ad anticipare la cazzata che sta facendo quello che c’è davanti, IA deve evolvere in maniera esponenziale per poter arrivare lontanamente ai nostri livelli.

Certo che il paragone è proprio calzante eh. A parte la differenza di costo, ma ti sembra la stessa cosa mantenere un aereo in volo livellato con nessuno intorno piuttosto che condurre un’auto in mezzo al traffico. In secondo luogo, si tratta comunque di un sistema di guida di livello 2 dove è obbligatorio tenere le mani sul volante e prestare sempre attenzione. In terzo luogo, se lo avessi almeno provato invece di dispensare saggezza gratuita, ti renderesti conto che generalmente ha tempi di reazione molto più rapidi di un essere umano. Ma vabbeh… lasciamo perdere, contro i preconcetti non vale nemmeno la pena di perdere tempo…

Ma che film guardava😂, ? Con l’Autopilot inserito e l’auto in movimento, non si possono guardare i film.

Di sicuro non sul tablet dell’auto. Certo che a volte la fantasia supera la realtà.